Một AI Agent là một thực thể phần mềm tự chủ, thường được sử dụng để gia tăng khả năng của một mô hình ngôn ngữ lớn. Đây là những điều nhà phát triển cần biết.

Với sự phát triển mạnh mẽ của các mô hình ngôn ngữ lớn (LLMs), một loại phần mềm mới được gọi là “trình tác vụ” đã ra đời nhằm gia tăng và cải thiện khả năng của LLM. Bài viết này giới thiệu các khái niệm chính về trình tác vụ và cách chúng bổ sung cho LLM.

Kể từ khi phát hành ban đầu của ChatGPT, dựa trên GPT-3.5, các mô hình ngôn ngữ lớn đã có những bước tiến hóa và trưởng thành. Một số bản phát hành gần đây – chẳng hạn như GPT-4o, Gemini Pro và các mô hình Claude Opus – thậm chí còn thể hiện khả năng suy luận tiên tiến. Hệ sinh thái của các mô hình ngôn ngữ mở cũng phát triển nhanh chóng trong thời gian gần đây. Nhiều biến thể của các LLM này đã được phát hành để sử dụng trong các môi trường riêng. Về khả năng và trả lời các câu hỏi phức tạp, một số mô hình ngôn ngữ mở – như Mistral và Llama 3 – ngang bằng với các mô hình thương mại. Tất cả những điều này đã thúc đẩy xu hướng sử dụng trình tác vụ AI (AI Agent).

AI agent và giới hạn của llm

AI Agent là gì?

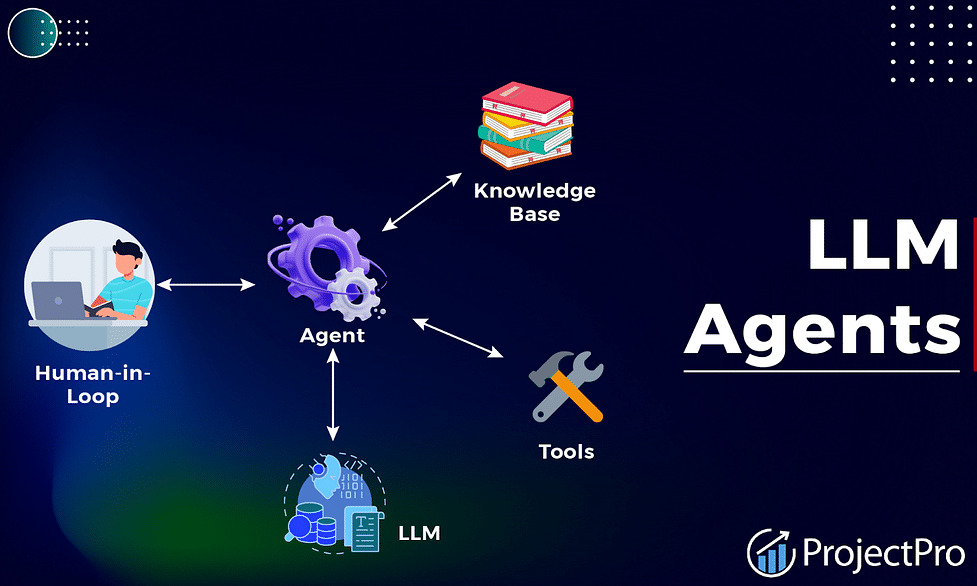

AI Agent là một phần mềm tự chủ tận dụng khả năng xử lý ngôn ngữ của Mô hình Ngôn ngữ Lớn (LLM) để thực hiện nhiều tác vụ vượt ra ngoài việc tạo và hiểu văn bản đơn thuần. AI Agent mở rộng chức năng của LLM bằng cách kết hợp các cơ chế để tương tác với môi trường kỹ thuật số, đưa ra quyết định và thực hiện các hành động dựa trên sự hiểu ngôn ngữ có được từ LLM.

Nếu như trong hệ điều hành, hãy coi LLM là hạt nhân và AI Agent là các chương trình.

AI Agent phụ thuộc nhiều vào LLM để thực hiện lý luận đồng thời tăng cường chức năng của LLM bằng cách bổ sung các khả năng mới.

LLM có một số hạn chế mà các AI Agent có thể khắc phục. Chúng ta hãy xem xét một số hạn chế này.

Hạn chế của LLM

-

LLM không có trí nhớ

Tương tự như cách gọi API REST, việc kích hoạt LLM hoàn toàn không có trạng thái. Mỗi tương tác với LLM là độc lập, nghĩa là mô hình không tự nhớ các trao đổi trước đó hoặc xây dựng dựa trên các cuộc hội thoại trước đó. Hạn chế này ảnh hưởng đến tính liên tục và mạch lạc của các tương tác lâu dài, vì mô hình không thể tận dụng bối cảnh lịch sử để thông tin cho các phản hồi trong tương lai. Bản chất không trạng thái của LLM đòi hỏi mỗi đầu vào phải hoàn toàn khép kín, dẫn đến các tương tác lặp đi lặp lại hoặc rời rạc trong các trường hợp sử dụng mở rộng.

-

Các yêu cầu của LLM là đồng bộ

LLM hoạt động theo cách đồng bộ, nghĩa là chúng xử lý và phản hồi từng đầu vào theo tuần tự, một lần một. Hoạt động đồng bộ này ngụ ý rằng mô hình phải hoàn thành phản hồi của nó cho một yêu cầu nhất định trước khi nó có thể xử lý yêu cầu tiếp theo. Xử lý tuần tự này có thể là một hạn chế trong các tình huống yêu cầu tương tác thời gian thực hoặc xử lý đồng thời nhiều truy vấn, vì nó không thể song song hóa việc xử lý các yêu cầu khác nhau.

-

LLM có thể ảo tưởng

LLM có thể tạo ra ảo tưởng, là những trường hợp mô hình tạo ra thông tin không chính xác về mặt sự thật hoặc vô nghĩa. Hiện tượng này xảy ra vì LLM được đào tạo trên các tập dữ liệu khổng lồ bao gồm văn bản từ internet, nơi chúng học các mẫu và mối tương quan thay vì độ chính xác về mặt sự thật. Kết quả là, chúng có thể bịa ra các chi tiết hoặc trình bày thông tin sai lầm một cách tự tin, tạo ra ảo giác về kiến thức.

-

LLM không thể truy cập internet

LLM không thể duyệt web hoặc kích hoạt dịch vụ web, vì vậy chúng bị giới hạn trong dữ liệu mà chúng được đào tạo và không có khả năng truy xuất hoặc xác minh thông tin từ các nguồn web trực tiếp theo thời gian thực. Ràng buộc này có nghĩa là phản hồi của chúng chỉ dựa solely trên kiến thức sẵn có được nhúng bên trong chúng, vốn có thể không được cập nhật hoặc phù hợp theo ngữ cảnh cho các truy vấn theo thời gian thực. Do đó, LLM không thể cung cấp cập nhật tin tức hiện tại, truy cập vào nghiên cứu mới nhất hoặc lấy dữ liệu từ các cơ sở dữ liệu trực tuyến năng động – khiến việc sử dụng chúng kém hiệu quả hơn cho các tác vụ yêu cầu thông tin mới nhất.

-

LLM kém toán

LLM thường kém xử lý các tác vụ toán học, đặc biệt là các tác vụ yêu cầu tính toán chính xác hoặc giải quyết vấn đề phức tạp. Hạn chế này xuất phát từ việc LLM chủ yếu được thiết kế để hiểu và tạo ra ngôn ngữ tự nhiên dựa trên các mẫu học được từ các tập dữ liệu văn bản khổng lồ. Mặc dù chúng có thể thực hiện các phép tính số học đơn giản và tuân theo các quy tắc toán học cơ bản, khả năng giải quyết các bài toán toán học phức tạp hơn hoặc đảm bảo độ chính xác trong các phép tính nhiều bước của chúng bị hạn chế. Chúng thường thiếu khả năng suy luận logic có cấu trúc cần thiết để thực hiện các phép toán nâng cao một cách đáng tin cậy.

-

Đầu ra của LLM không xác định

LLM thể hiện đầu ra không xác định về định dạng và cấu trúc dữ liệu. Điều này có nghĩa là cùng một yêu cầu có thể tạo ra các đầu ra khác nhau mỗi lần được xử lý. Sự thay đổi này bắt nguồn từ bản chất xác suất của các thuật toán nền tảng của LLM. Chúng lựa chọn trong số các phản hồi khả dĩ dựa trên các mẫu đã học được thay vì các quy tắc xác định. Kết quả là, định dạng và cấu trúc của đầu ra có thể khác nhau, gây khó khăn trong việc đạt được kết quả nhất quán, đặc biệt đối với các ứng dụng yêu cầu tính thống nhất về định dạng phản hồi – chẳng hạn như tạo báo cáo tự động, điền form hoặc trích xuất dữ liệu.

AI Agent cải thiện các giới hạn của LLM thế nào?

AI Agent đóng vai trò cầu nối giữa các công cụ phát triển phần mềm truyền thống và LLM, giúp giải quyết hoặc giảm nhẹ một số hạn chế nêu trên.

Ví dụ, bằng cách tích hợp các công cụ như duyệt web và môi trường thực thi mã, AI Agent có thể kết hợp dữ liệu thế giới thực với các phép tính phức tạp trước khi yêu cầu LLM phân tích và tạo ra phản hồi chi tiết.

Trong ngữ cảnh của hệ điều hành, hãy coi LLM là hạt nhân và AI Agent là các chương trình. Vỏ bao gồm các công cụ và dịch vụ hỗ trợ cần thiết cho Agent để thực thi. AI Agent tăng cường chức năng của LLM bằng cách kết nối nó với các công cụ và dịch vụ bên ngoài cần thiết để hoàn thành một tác vụ.

Hãy cùng tìm hiểu vai trò của AI Agent trong việc gia tăng khả năng của LLM.

-

Lưu trữ bộ nhớ và duy trì ngữ cảnh

Không giống như LLM, vốn không có trạng thái và không lưu giữ bộ nhớ về các tương tác trước đó, AI Agent có thể kết hợp các cơ chế bộ nhớ để ghi nhớ các tương tác trong quá khứ và xây dựng dựa trên chúng. Điều này cho phép thực thể duy trì tính liên tục và mạch lạc trong các tương tác lâu dài, tận dụng bối cảnh lịch sử để thông tin cho các phản hồi trong tương lai. Khả năng này nâng cao trải nghiệm người dùng bằng cách tạo ra các tương tác được cá nhân hóa và phù hợp với ngữ cảnh hơn.

-

Xử lý không đồng bộ và song song

Trong khi LLM xử lý các đầu vào theo cách đồng bộ và tuần tự, thì AI Agent có thể quản lý nhiều tác vụ đồng thời và hoạt động không đồng bộ. Khả năng song song hóa các quy trình này cho phép AI Agent xử lý các tương tác theo thời gian thực hiệu quả hơn, cải thiện hiệu suất và khả năng phản hồi trong các tình huống yêu cầu xử lý đồng thời nhiều truy vấn hoặc tác vụ.

-

Xác minh và truy cập thông tin theo thời gian thực

AI Agent có thể giảm thiểu vấn đề ảo tưởng trong LLM bằng cách kết hợp xác minh dữ liệu theo thời gian thực và truy cập vào các nguồn thông tin bên ngoài. Bằng cách kết nối với internet hoặc các cơ sở dữ liệu cụ thể, AI Agent có thể xác nhận tính chính xác của thông tin do LLM tạo ra, đảm bảo độ chính xác và giảm thiểu các đầu ra sai hoặc gây hiểu lầm. Điều này làm cho AI Agent đặc biệt có giá trị trong các ứng dụng đòi hỏi thông tin cập nhật và chính xác.

-

Nâng cao khả năng toán học

AI Agent có thể tích hợp các công cụ toán học chuyên dụng hoặc phần mềm để xử lý các phép tính phức tạp và nhiệm vụ giải quyết vấn đề, bù đắp cho những điểm yếu về toán học của LLM. Sự tích hợp này cho phép AI Agent thực hiện các phép toán chính xác và đáng tin cậy, mở rộng tiện ích của chúng trong các lĩnh vực kỹ thuật và khoa học.

-

Định dạng đầu ra nhất quán

Để giải quyết bản chất không xác định của đầu ra LLM, AI Agent có thể triển khai các bước xử lý hậu kỳ để chuẩn hóa định dạng và cấu trúc của phản hồi. Ví dụ, chúng có thể yêu cầu đầu ra từ LLM luôn được định dạng theo JSON hoặc XML. Bằng cách đảm bảo tính nhất quán trong việc trình bày dữ liệu, AI Agent có thể nâng cao độ tin cậy của đầu ra trong các ứng dụng yêu cầu tính đồng nhất, chẳng hạn như tạo báo cáo và trích xuất dữ liệu.

-

Tương tác dựa trên cá tính

AI Agent nâng cao các tương tác dựa trên cá tính với LLM bằng cách tận dụng khả năng ghi nhớ và cá nhân hóa để tạo ra trải nghiệm người dùng được điều chỉnh và hấp dẫn hơn. Bằng cách duy trì ngữ cảnh trong nhiều tương tác, AI Agent có thể điều chỉnh phản hồi để phù hợp với sở thích, lịch sử và phong cách hội thoại của người dùng – hiệu quả mô phỏng một cá tính nhất quán. Cách tiếp cận được cá nhân hóa này không chỉ cải thiện mức độ hài lòng của người dùng mà còn cho phép AI Agent cung cấp hỗ trợ có liên quan và nhận thức theo ngữ cảnh hơn. AI Agent có thể điều chỉnh hành vi của mình một cách linh hoạt dựa trên phản hồi của người dùng và các tương tác trước đó, giúp cuộc trò chuyện cảm thấy tự nhiên và giống con người hơn.

Kết luận

LLM đã phát triển đáng kể, được minh họa bằng các mô hình như GPT-4o và Gemini 1.5. Tuy nhiên, chúng vẫn không có trạng thái, xử lý yêu cầu tuần tự, có thể ảo tưởng, thiếu quyền truy cập dữ liệu theo thời gian thực, gặp khó khăn với các bài toán phức tạp và tạo ra đầu ra không xác định. AI Agent gia tăng LLM bằng cách kết hợp các cơ chế bộ nhớ để duy trì ngữ cảnh, quản lý các tác vụ không đồng bộ và xác nhận thông tin theo thời gian thực.

Nguồn: https://thenewstack.io/ai-agents-key-concepts-and-how-they-overcome-llm-limitations/

![[Google I/O 2026] Kỷ Nguyên “Agentic Enterprise” Bùng Nổ: Toàn Cảnh Các Đột Phá AI Mới Nhất Từ Google Cloud](https://aichatbot.com.vn/wp-content/uploads/google-io-2026-ai.jpg)

0 Lời bình